Edge Computing: Einsatz an der Peripherie

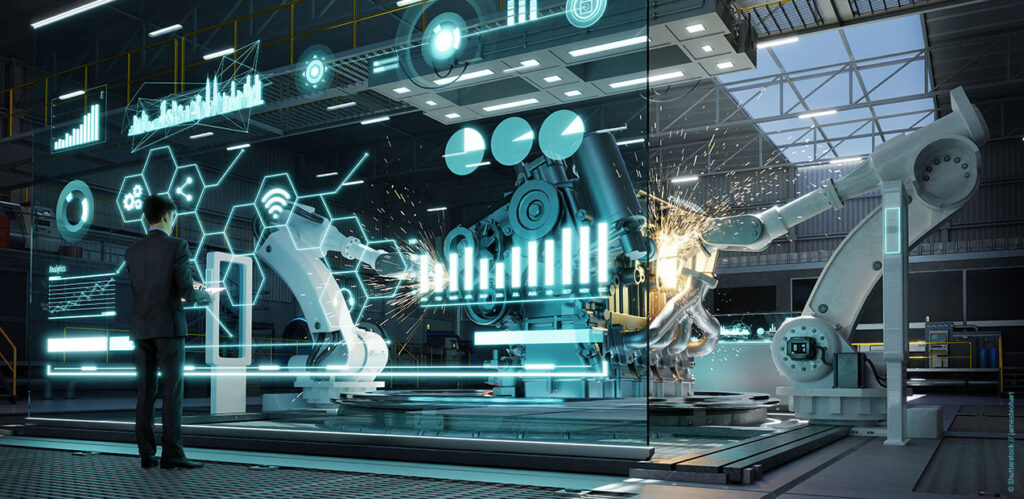

Die Nutzung von Ressourcen und Dienstleistungen in Form einer Cloud-Lösung, quasi die Nutzung von XaaS-Diensten hat in den letzten Jahren deutlich zugenommen und wird in den nächsten Jahren sowohl quantitativ als auch qualitativ noch deutlich zulegen, dafür sorgen nicht zuletzt auch Big Player wie Microsoft und Google. Eine entsprechende Aussage trifft auch auf die Zahl der miteinander vernetzten Geräte zu, denn ein Schlüsselaspekt vom Internet of Things (IoT) und Industrie 4.0 ist die Konnektivität. Das hier behandelte Edge Computing (auch Fog Computing) ist ein Ansatz, um die Leistung bei vernetzen Geräten und/ oder Cloudstrukturen weiter zu optimieren.

Warum Edge Computing?

Ein fundamentales Problem, welches bei vernetzten Geräten und auch bei Cloud-Anwendungen auftritt, ist, dass in Zeiten von IoT und Big Data die Mengen an Daten, die es zu sammeln, verarbeiten und versenden gibt, immer umfangreicher werden und damit auch die Anforderungen an die Leistung und somit die Hardware steigen. Das Edge Computing-Konzept befasst sich mit diesem Sachverhalt und verfolgt den Ansatz, die für einen Prozess benötigte Rechenleistung in unmittelbarer Nähe des Benutzers abzurufen, d.h. bestimmte Prozesse an die Peripherie-Hardware auszulagern, dabei kann es sich um ein Gerät, Sensor oder Netzwerk handeln. Beim Edge Computing handelt es sich also um ein Verbundsystem aus zentraler Verarbeitungseinheit (z.B. eine Cloud) und „Edge“-Geräten, die an den sogenannten Knotenpunkten (also direkt vor Ort oder in unmittelbarer Nähe) sitzen und mit- und untereinander kommunizieren, in einem Eigenheim beispielsweise ein Netzwerk verschiedener Smart Home-Geräte, die zusätzlich über eine API mit einem Remote-Rechenzentrum oder einer Cloud-Infrastruktur eines Anbieters verbunden sind.

Vorteile von Edge Computing

Beim Edge-Computing werden viele Daten direkt an den Knotenpunkten verarbeitet und zudem werden die Daten gefiltert und bereinigt, bevor sie an das zentrale Verarbeitungssystem ( z.B. die Cloud) gesendet werden. Dadurch wird zum einem die Datenmenge, zum anderen die Häufigkeit von Datentransfers reduziert. Das System wird dadurch leistungsfähiger und die Netzwerk-Latenz niedriger. Auch wird von Befürwortern des Öfteren auch eingeworfen, dass durch die Prozessauslagerung an die Peripherie ein verstärktes Kontextbewusstsein entsteht, da die Verarbeitung direkt dort stattfindet, wo der richtige Kontext in Bezug auf Ort, Zeit und weiteren Faktoren bereits gegeben ist.

Edge Computing stellt also ein Konzept für eine verteilte Infrastruktur dar, wo Arbeitsprozesse, dort wo sie möglich sind, an die Peripherie ausgelagert werden. Dieser vielversprechende Ansatz, der, je nach Anwendungsgebiet, die Leistungsfähigkeit von Systemen deutlich steigern kann, lohnt weiter verfolgt zu werden.

Schreiben Sie einen Kommentar